En annen AI-modell har sluttet seg til havet av AI-modeller, og denne er fra OpenAI igjen. OpenAI ga tidligere ut GPT-4o i år som skulle være mer effektiv enn GPT-4. Men det var fortsatt ganske dyrt og kunne koste mye, spesielt for utviklere som trenger å ringe AI-modellen gjennom API-en for appene sine gjentatte ganger i løpet av dagen.

Som et resultat vendte utviklere seg til billigere små AI-modeller fra konkurrenter, som Gemini 1.5 Flash eller Claude 3 Haiku.

Nå slipper OpenAI GPT-4o mini, deres mest kostnadseffektive modell til nå, som de også går inn i den lille AI-modellplassen med. Mens GPT-4o mini er den billigste modellen til nå, oppnår den ikke så lave kostnader ved å kutte ned på intelligens; den er smartere enn deres eksisterende GPT-3.5 Turbo-modell.

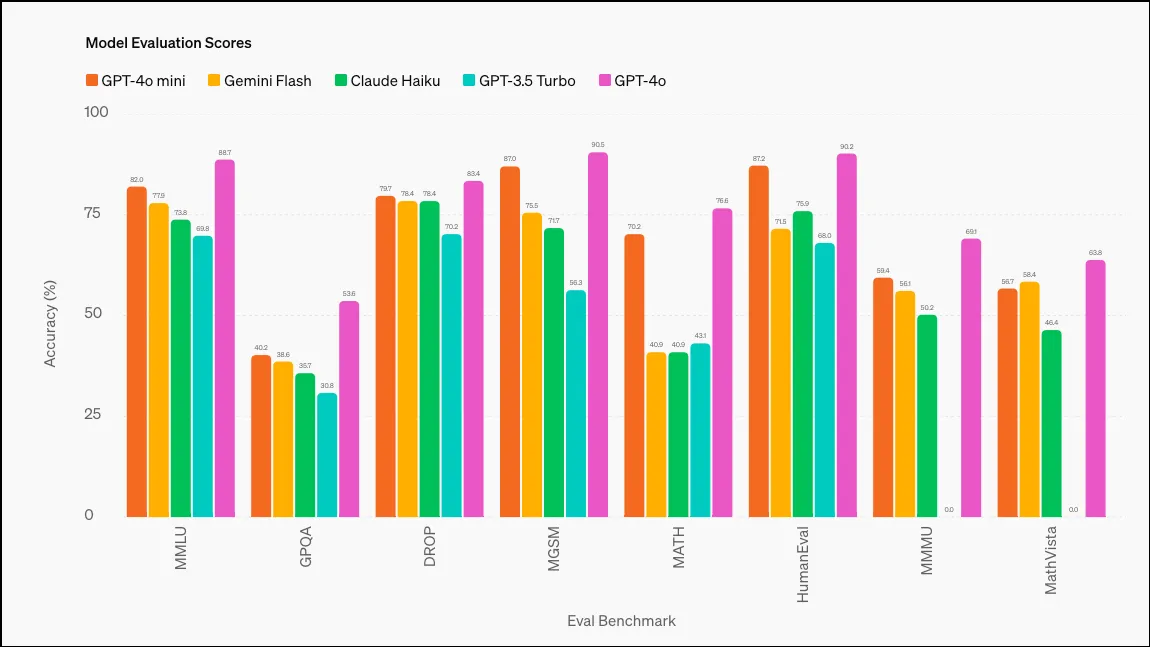

I følge OpenAI, scoret GPT-4o mini 82 % i MMLU (Measuring Massive Multitask Language Understanding), og utkonkurrerte mange modeller; dette er de respektive poengsummene til forskjellige modeller: GPT-3,5 Turbo (70 %), Claude 3 Haiku (75,2 %) og Gemini 1,5 Flash (78,9 %). GPT-4o scoret 88,7 % på denne referansen, med Gemini Ultra som har den høyeste poengsummen – 90 % (dette er imidlertid ikke små AI-modeller).

GPT-4o mini rulles ut til ChatGPT Free, Team og Plus-brukere samt utviklere i dag. For ChatGPT-brukere har den i hovedsak erstattet GPT-3.5; GPT-4o mini vil være modellen samtalen bruker som standard når du går tom for gratis GPT-4o-spørringer. Utviklere vil fortsatt ha muligheten til å bruke GPT-3.5 gjennom API, men det vil til slutt bli droppet. ChatGPT Enterprise-brukere vil få tilgang til GPT-4o mini neste uke.

Som nevnt ovenfor, er fokuset til GPT-4o mini å hjelpe utviklere med å finne en lavkostnads- og latensmodell for appen deres som også er kapabel. Sammenlignet med andre små modeller utmerker GPT-4o mini seg på resonneringsoppgaver i både tekst og syn, matematisk resonnering og kodeoppgaver, samt multimodal resonnering.

Den støtter for tiden både tekst og visjon i API, med støtte for tekst-, bilde-, video- og lydinnganger og -utganger på veikartet for fremtiden.

GPT-4o mini har et kontekstvindu på 128K tokens for input og 16K tokens for output per forespørsel, med kunnskapen som går opp til oktober 2023. Den kan også håndtere ikke-engelsk tekst ganske kostnadseffektivt.

Legg att eit svar